قبل بضعة أسابيع، طلب البنتاغون من شركة Anthropic، الشركة التي تقف وراء مساعد الذكاء الاصطناعي كلود، تعديل عقد حالي بقيمة 200 مليون دولار وإزالة حاجزين رئيسيين. كان هذا بمثابة حظر على استخدام التكنولوجيا الخاصة بها للمراقبة الجماعية المحلية والأسلحة المستقلة بالكامل. رفضت Anthropic وذهب العقد إلى OpenAI بدلاً من ذلك.

لقد سلط هذا النزاع الضوء على سؤال ربما لم يفكر معظمنا فيه كثيرًا: هل يستطيع الذكاء الاصطناعي فعل هذه الأشياء بالفعل؟ وإذا كان الأمر كذلك، فإلى أي حد يجب أن نشعر بالقلق؟

الإجابة المختصرة، وفقًا للخبراء الذين تحدثت إليهم، هي أن هذا ليس خيالًا علميًا. انها بالفعل هنا. لكن الصورة أكثر تعقيدا – وفي بعض النواحي أكثر إثارة للقلق – من الروبوتات القاتلة التي اعتدنا رؤيتها على الشاشة الكبيرة.

يستمر المقال أدناه

المراقبة الجماعية تحدث بالفعل

يقول لي جيمس ويلسون، عالم أخلاقيات الذكاء الاصطناعي العالمي ومؤلف كتاب “الإهمال الاصطناعي”: “إن المراقبة الجماعية ليست قابلة للتطبيق فحسب، بل إنها تحدث بالفعل”. “لقد جعلت تقنيات مثل Palantir وCCTV هذا الأمر ممكنًا لسنوات. والأمر متروك للدول الفردية فقط فيما يتعلق بما إذا كانت تختار القيام بذلك أم لا.”

كان برنامج PRISM التابع للحكومة الأمريكية، والذي كشف عنه إدوارد سنودن منذ أكثر من عقد من الزمن، مثالاً مبكرًا للمراقبة على نطاق واسع.

يقول ويلسون: “لقد سهّل التقدم في الذكاء الاصطناعي القيام بذلك على نطاق واسع، ووجودنا المتصل بشكل متزايد يعني أن هناك الكثير من مصادر البيانات التي يمكنهم الوصول إليها، سواء بموافقة الأشخاص أو بدونها”.

إن الجدل الأخير حول كاميرات Ring Doorbell وقارئات لوحة ترخيص Flock التي تستخدمها الشرطة بعد Super Bowl هو أحدث مثال على ذلك.

وهذا يهم الناس العاديين، وليس فقط المعارضين السياسيين. أخبرني جيف واتكينز، مستشار الذكاء الاصطناعي المتخصص في الحوكمة والأمن، أن هذا النوع من المراقبة يشير إلى نمط واضح بالفعل في المملكة المتحدة.

قال لي واتكينز: “لقد رأينا العديد من المقالات الإخبارية الأخيرة حول الأشخاص الذين يتم التعرف عليهم بشكل خاطئ بواسطة أنظمة التعرف على الوجه في السوبر ماركت، مع القلق الطويل الأمد من أن هذه الأخطاء في التعرف على الهوية يمكن أن تؤثر بشكل غير متناسب على النساء والأقليات العرقية”.

التأثير التراكمي هو تحول في كيفية عمل المجتمع. يقول واتكينز: “إن الخضوع للاستخدام الخوارزمي لتقنيات المراقبة يحرك القرص نحو مجتمع” الشك افتراضيًا “، حيث يمكن للأطراف الأبرياء، الذين يمارسون حياتهم اليومية، أن تُداس حقوقهم من خلال تصنيف الذكاء الاصطناعي”.

الأسلحة المستقلة موجودة بالفعل هنا

وينطبق الشيء نفسه على الأسلحة الفتاكة المستقلة. يقول ويلسون: “أول استخدام مسجل كان من قبل تركيا ضد هدف ليبي باستخدام طائرة بدون طيار من طراز كارغو في عام 2021”. ومنذ ذلك الحين، تطورت التكنولوجيا بسرعة. “إن التقدم في الذكاء الاصطناعي يعني أن هذا ممكن الآن على نطاق أوسع بكثير، فضلا عن كونه رخيصا بشكل لا يصدق.”

لكن المشكلة الأساسية هنا هي الدقة، وما يعنيه عدم الدقة عندما تكون المخاطر هي الحياة أو الموت. يقول ويلسون: “إن رؤية الكمبيوتر للتعرف على الأشخاص على الوجه تكون دقيقة بنسبة 90% فقط في أفضل الأوقات، وإذا استخدم النظام الذكاء الاصطناعي التوليدي، فسوف يصاب بالهلوسة، لأنها ميزة وليست خطأ في التكنولوجيا”.

وقد تم الاعتراف منذ ذلك الحين بأن برنامج الاستهداف بالذكاء الاصطناعي التابع لقوات الدفاع الإسرائيلية، لافندر، والذي تم استخدامه للتعرف على أعضاء حماس المشتبه بهم، كان خاطئًا بنسبة 10% من الحالات. حتى أفضل عارضي اللغات الكبيرة ما زالوا يهلوسون بمعدل 5-10%، وفقًا للوحة المتصدرين القياسية الخاصة بـ Hugging Face's Vectara. قد تبدو نسبة العشرة بالمائة صغيرة. ولكن على نطاق واسع تعمل هذه الأنظمة حقًا ليس كذلك.

قد تعتقد أن الجواب هو المزيد من الرقابة البشرية. ولكن هذا هو بالضبط ما صممت بعض التطبيقات العسكرية لتقليله. يقول ويلسون: “إن إزالة القدرة البشرية على تحديد الهدف هو بالتالي حقل ألغام أخلاقي”. “على مستوى أساسي، فإن إزالة التصميم البشري من سلسلة القتل هو إزالة أي شكل من أشكال الكرامة الإنسانية.”

ويقول واتكينز إنه يزيل المسؤولية أيضًا. “إذا لم يكن هناك أحد للضغط على زر “إطلاق النار”، فمن الذي يمكن محاسبته في حالة فقدان الأرواح، سواء كان ذلك مبررًا أم غير ذلك؟ الذكاء الاصطناعي ليس شخصًا قانونيًا ولا يمكن مساءلته بنفسه”.

هل يجب أن نقلق بشأن فيلم “Terminators”؟

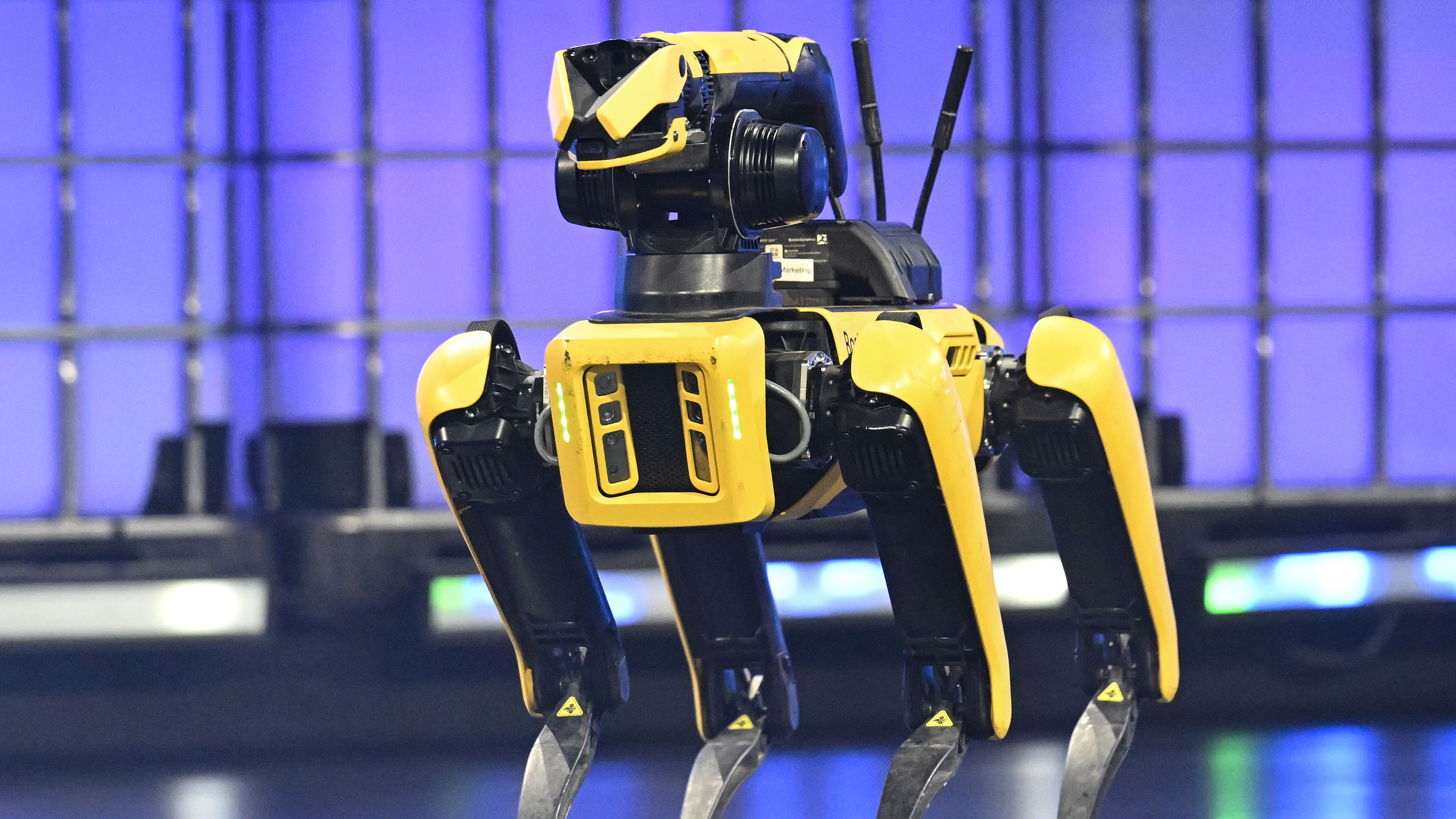

بالنسبة لأي شخص نشأ وهو يشاهد أفلام Terminator، ربما تبدو مقاطع الفيديو الحديثة عن الروبوتات من شركة Boston Dynamics وشركات التكنولوجيا الصينية مثل Xpeng مألوفة بشكل غير مريح.

لكن ويلسون، الذي أمضى بعض الوقت في دراسة نماذج مماثلة، يحث على المنظور المنظوري. “على الرغم من كل مقاطع الفيديو الخاصة بالروبوتات الفاخرة والمصممة بشكل جيد والتي تأتي من الصين والولايات المتحدة، إلا أنها لم تصل إلى هذا الحد. فهي لا تزال بحاجة إلى الكثير من العمل لإيصالها إلى مرحلة يمكنها من خلالها التفاعل بشكل مستقل تمامًا مع عالمنا.”

ويقول إن القلق الأكثر إلحاحا ليس الروبوتات البشرية. “أنا أكثر قلقا بشأن أسراب الأسلحة ذاتية القيادة بدون طيار. هذه التكنولوجيا موجودة بالفعل، وهي رخيصة بما يكفي بحيث يمكن بناؤها اليوم بشكل جماعي، من قبل أي شخص حرفيا.”

لكن التحذير الأوسع يأتي من واتكينز، ويمتد إلى ما هو أبعد من السياق العسكري. “عندما تقوم المنظمات والحكومات بتسليم الكثير من عملية صنع القرار إلى أنظمة معيبة وغير ناضجة غير مفهومة أو قابلة للتفسير بشكل كامل، دون تدقيق قوي، فإن ذلك يمكن أن يؤدي إلى تآكل حقوق الإنسان وتعكير مياه المساءلة”.

لم تكن المواجهة الإنسانية تتعلق بعقد شركة واحدة بقدر ما كانت تتعلق بسؤال سيتعين علينا جميعًا الإجابة عليه في جميع المجالات: من الذي يقرر مدى ثقتنا في هذه الأنظمة – ومن المسؤول عندما تكون مخطئة؟

التعليقات