- يدعم XpertStation WS300 نماذج تريليون معلمة دون الاعتماد على البنية التحتية السحابية

- تتيح منافذ LAN المزدوجة بسرعة 400 جيجابت إمكانية أحمال عمل الذكاء الاصطناعي الموزعة عالية السرعة ومتعددة العقد

- تعمل وحدة معالجة الرسومات HBM3e الموحدة وذاكرة وحدة المعالجة المركزية LPDDR5X على زيادة عرض النطاق الترددي للذكاء الاصطناعي إلى الحد الأقصى

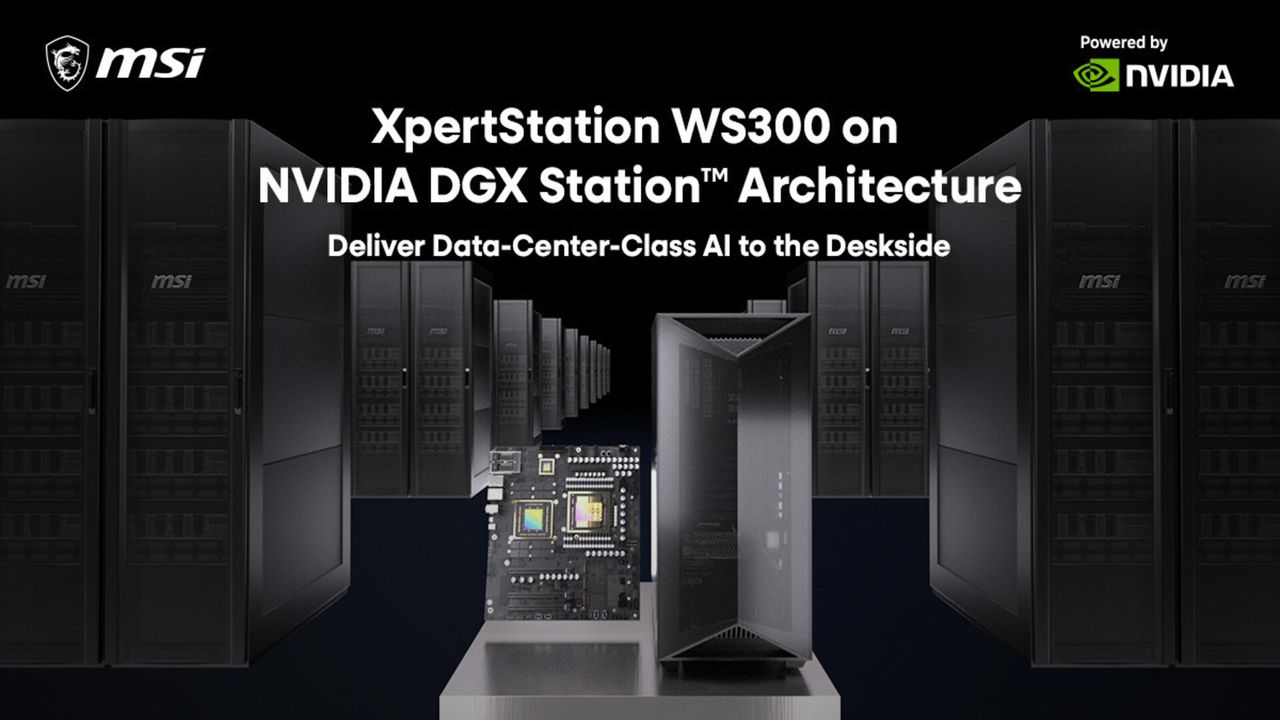

أطلقت MSI رسميًا XpertStation WS300، وهي محطة عمل مكتبية تعمل بالذكاء الاصطناعي تعتمد على بنية DGX Station من Nvidia.

تم تصميم هذا النظام للتعامل مع نماذج اللغات الكبيرة المطلوبة والذكاء الاصطناعي التوليدي وأحمال عمل علوم البيانات المتقدمة.

يتم تشغيل النظام الأساسي بواسطة Nvidia GB300 Grace Blackwell Ultra Desktop Superchip ويدعم ما يصل إلى 748 جيجابايت من الذاكرة الموحدة الكبيرة المتماسكة.

يستمر المقال أدناه

بنية ذاكرة موحدة لمعالجة الذكاء الاصطناعي ذات النطاق الترددي العالي

يجمع XpertStation WS300 بين ذاكرة وحدة معالجة الرسومات HBM3e وذاكرة وحدة المعالجة المركزية LPDDR5X لمشاركة البيانات ذات النطاق الترددي العالي.

يسمح هذا التكوين بالمعالجة المحلية لنماذج تريليون معلمة ويدعم سير عمل الذكاء الاصطناعي الشامل دون الاعتماد على البنية التحتية السحابية.

تتضمن محطة العمل منافذ LAN مزدوجة بسرعة 400 جيجابت، والتي تتيح الحوسبة الموزعة متعددة العقد مع عرض نطاق ترددي إجمالي يصل إلى 800 جيجابت في الثانية.

تدعي MSI أن XpertStation WS300 يقدم أداء فئة مركز البيانات مباشرة إلى بيئة سطح المكتب، مع إعداده المخصص لمساعدة المؤسسات على الانتقال من التجريب إلى الإنتاج مع الحفاظ على موثوقية حسابية متسقة.

يدعم XpertStation WS300 دورة حياة الذكاء الاصطناعي الكاملة، بما في ذلك التدريب على النماذج واسعة النطاق، والتحليلات المكثفة للبيانات، والاستدلال في الوقت الفعلي.

من خلال العمل كعقدة حوسبة مركزية للذكاء الاصطناعي، تتيح المنصة الضبط الدقيق التعاوني والنشر حسب الطلب، ولكنها تحتفظ بالتحكم في بياناتها وملكيتها الفكرية.

يعمل تخزين PCIe Gen5 وGen6 NVMe عالي السرعة على تسريع عملية استيعاب مجموعة البيانات وخطوط أنابيب الذكاء الاصطناعي، مما يضمن الاستخدام المستدام أثناء العمليات الحسابية المكثفة.

ومن خلال دمجها مع Nvidia AI Software Stack، تدمج محطة العمل الأجهزة والبرامج للسماح بالانتقال السلس لسير العمل من بيئات البحث إلى بيئات الإنتاج.

قامت MSI أيضًا بدمج Nvidia NemoClaw، وهو عبارة عن مكدس مفتوح المصدر يقوم بتشغيل OpenShell ضمن وضع الحماية الذي تسيطر عليه السياسة.

يتيح ذلك لوكلاء الذكاء الاصطناعي المستقلين العمل بشكل مستمر وآمن على جانب المكتب، باستخدام إمكانات الحوسبة التي تبلغ 20 بيتا فلوبس لمحطة العمل.

ويدعم التكوين عمليات الذكاء الاصطناعي التي تعمل دائمًا محليًا، مما يتيح إجراء التجارب باستخدام تطبيقات الذكاء الاصطناعي والروبوتات المتقدمة دون نقل أعباء العمل الحساسة إلى الخوادم السحابية.

وقال داني هسو، المدير العام لحلول منصة المؤسسات في MSI: “تتمتع MSI برؤية استراتيجية لتطوير الحوسبة القائمة على الذكاء الاصطناعي أولاً”.

“مع Nvidia، نحن نحدد العصر التالي للبنية التحتية للذكاء الاصطناعي، ونربط بين الأداء المركزي والابتكار الموزع، ونمكن المؤسسات من الانتقال من التجريب إلى الإنتاج بسرعة أكبر وحجم وثقة أكبر.”

توفر المنصة إمكانات واسعة النطاق لسير عمل الذكاء الاصطناعي المتقدم، ولكن سعرها البالغ 84999.99 دولارًا يثير مخاوف بشأن كفاءة التكلفة.

قد تجد المؤسسات التي لا تحتاج إلى الحد الأقصى من الذاكرة أو التشغيل المستمر لنموذج تريليون معلمة صعوبة في تبرير الاستثمار.

ويقدم النظام أداءً محليًا غير مسبوق للذكاء الاصطناعي، مما يتيح إجراء عمليات حسابية صعبة على المكتب.

ومع ذلك، من المحتمل أن تقتصر القيمة العملية لمحطة العمل هذه على المؤسسات ذات أعباء عمل الذكاء الاصطناعي عالية الإنتاجية ومتطلبات البنية التحتية المحددة.

اتبع TechRadar على أخبار جوجل و أضفنا كمصدر مفضل للحصول على أخبار الخبراء والمراجعات والآراء في خلاصاتك. تأكد من النقر على زر المتابعة!

وبالطبع يمكنك أيضًا اتبع TechRadar على TikTok للحصول على الأخبار والمراجعات وفتح الصناديق في شكل فيديو، والحصول على تحديثات منتظمة منا على واتساب أيضاً.

التعليقات