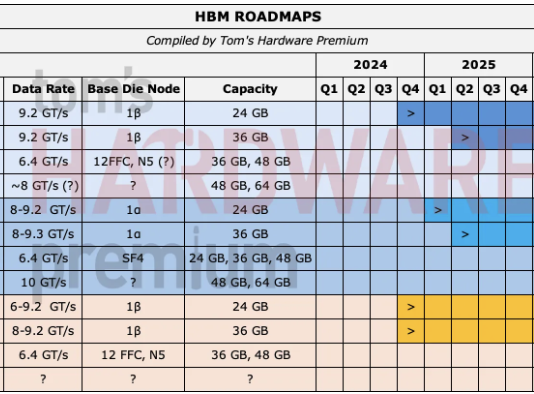

خرائط طريق Tom's Hardware Premium

خلال جلسة الأسئلة والأجوبة في معرض CES 2026 في لاس فيجاس، تعرض الرئيس التنفيذي لشركة Nvidia Jensen Huang إلى بعض الارتباك. مع مسرعات SRAM الثقيلة، والذاكرة الأرخص، ونماذج الذكاء الاصطناعي ذات الوزن المفتوح التي تكتسب قوة جذب، هل تستطيع Nvidia في النهاية تخفيف اعتمادها على HBM باهظة الثمن والهوامش التي تأتي معها؟

لماذا تبدو SRAM جذابة؟

دعونا نعود خطوة إلى الوراء للحظة ونفكر في ما يريده هوانغ هنا. تبحث الصناعة، بشكل عام، بنشاط عن طرق لجعل الذكاء الاصطناعي أرخص. يتم طرح كل من مسرعات SRAM، واستدلال GDDR، ونماذج الوزن المفتوح كصمامات ضغط على أغلى مكونات Nvidia، وملاحظات Huang هي تذكير بأنه بينما تعمل هذه الأفكار بمعزل عن غيرها، فإنها تتصادم مع الواقع بمجرد تعرضها لأنظمة الذكاء الاصطناعي على نطاق الإنتاج.

لم يجادل هوانغ في مزايا الأداء للتصميمات المرتكزة على SRAM. في الواقع، كان صريحًا بشأن سرعتهم. وقال: “بالنسبة لبعض أعباء العمل، قد يكون الأمر سريعًا إلى حد جنوني”، مشيرًا إلى أن الوصول إلى SRAM يتجنب عقوبات زمن الوصول حتى لأسرع الذاكرة الخارجية. “SRAM أسرع بكثير من الانطلاق حتى إلى ذكريات HBM.”

هذا هو السبب في أن المسرعات ذات السعة الكبيرة لـ SRAM تبدو مقنعة جدًا في المعايير والعروض التوضيحية الخاضعة للرقابة. يمكن للتصميمات التي تفضل SRAM على الرقاقة أن توفر إنتاجية عالية في سيناريوهات مقيدة، ولكنها تتعارض مع حدود السعة في أعباء عمل الذكاء الاصطناعي للإنتاج لأن SRAM لا يمكنها مطابقة توازن كثافة عرض النطاق الترددي الذي توفره HBM، وهذا هو السبب وراء استمرار معظم مسرعات الذكاء الاصطناعي الحديثة في إقران الحوسبة مع حزم DRAM ذات النطاق الترددي العالي.

لكن هوانج عاد مرارًا وتكرارًا إلى النطاق والتنوع باعتبارهما نقطة الانهيار. إن سعة SRAM ببساطة لا تنمو بسرعة كافية لاستيعاب النماذج الحديثة بمجرد مغادرة المختبر. حتى في عملية نشر واحدة، يمكن أن تتجاوز النماذج الذاكرة الموجودة على الرقاقة لأنها تضيف طول السياق، أو منطق التوجيه، أو طرائق إضافية.

في اللحظة التي يتجاوز فيها النموذج ذاكرة SRAM، تنهار ميزة الكفاءة. عند هذه النقطة، إما أن النظام يتوقف أو يحتاج إلى ذاكرة خارجية، وعند هذه النقطة يفقد التصميم المتخصص ميزته. ارتكزت حجة هوانغ على كيفية تطور أنظمة الذكاء الاصطناعي للإنتاج بعد نشرها. وقال: “إذا احتفظت بكل شيء على ذاكرة SRAM، فبالطبع لن أحتاج إلى ذاكرة HBM”، مضيفًا أن “… المشكلة هي أن حجم النموذج الذي يمكنني الاحتفاظ به داخل ذاكرة SRAM هذه أصغر بمقدار 100 مرة.”

أعباء العمل التي ترفض البقاء ساكنة

جاءت بعض تعليقات هوانغ الأكثر دلالة عندما وصف كيف تتصرف أعباء عمل الذكاء الاصطناعي الحديثة في البرية. وقال: “أعباء العمل تتغير في كل وقت”. “في بعض الأحيان يكون لديك وزارة التعليم. (خليط من الخبراء). وفي بعض الأحيان يكون لديك أشياء متعددة الوسائط. وفي بعض الأحيان يكون لديك نماذج الانتشار. وفي بعض الأحيان يكون لديك نماذج الانحدار التلقائي. وفي بعض الأحيان يكون لديك نماذج SSM. (إدارة الخادم التسلسلية)”

كل من هذه البنى تؤكد على الأجهزة بشكل مختلف. بعضها مرتبط بالذاكرة، بينما يدفع البعض الآخر عرض النطاق الترددي للتوصيل البيني. يطلب البعض زمن وصول منخفض، بينما يتسامح البعض الآخر مع التجميع والتأخير. “هذه النماذج كلها مختلفة قليلا في الشكل والحجم،” لخص هوانغ ذلك بصراحة. والأهم من ذلك، أن هذه الضغوط تتغير بشكل ديناميكي. وقال: “في بعض الأحيان يقومون بنقل الضغط على NVLink. وفي بعض الأحيان يقومون بنقل الضغط على ذاكرة HBM. وفي بعض الأحيان يقومون بنقل الضغط على الثلاثة”.

هذه هي الحجة الأساسية التي تدعم قضية المرونة التي تقدمها Nvidia. إن النظام الأساسي الذي تم تحسينه بشكل ضيق لنمط ذاكرة واحد أو نموذج تنفيذ يخاطر بترك السيليكون باهظ الثمن خاملاً عندما يتغير عبء العمل. في مراكز البيانات المشتركة، حيث يحدد الاستخدام على مدار الأسابيع والأشهر ما إذا كان ذلك مجديًا اقتصاديًا، فإن ذلك يمثل مسؤولية خطيرة.

وقال هوانغ: “قد تكون قادرًا على تحمل عبء عمل معين ودفعه إلى أقصى الحدود”. “ولكن هذا الـ 10% من عبء العمل، أو حتى 5% من عبء العمل، إذا لم يتم استخدامه، ففجأة كان من الممكن استخدام هذا الجزء من مركز البيانات لشيء آخر.” بمعنى آخر، يرى هوانج أن ذروة الكفاءة في مهمة واحدة أقل أهمية من المنفعة المتسقة عبر العديد من المهام.

لا تزال النماذج المفتوحة تصل إلى حدود الذاكرة

تطرق السؤال الأصلي أيضًا إلى نماذج الذكاء الاصطناعي المفتوحة وما إذا كان من الممكن أن تقلل من نفوذ Nvidia على مكدس الذكاء الاصطناعي. كان الاقتراح هو أن النماذج المفتوحة، جنبًا إلى جنب مع التصميمات ذات سعة SRAM الثقيلة والذاكرة الرخيصة، يمكن أن تقلل الاعتماد على أغلى وحدات معالجة الرسوميات من Nvidia وتحسن الهوامش عبر المكدس.

في حين أشاد هوانغ بالنماذج المفتوحة علنًا، وأصدرت شركة Nvidia أوزانها المفتوحة ومجموعات البيانات الخاصة بها، فقد أوضحت تصريحاته في معرض CES أن الانفتاح لا يلغي قيود البنية التحتية. لا يزال التدريب وتقديم النماذج التنافسية يتطلب موارد هائلة للحوسبة والذاكرة، بغض النظر عن الترخيص. لا تلغي الأوزان المفتوحة الحاجة إلى مجموعات ذاكرة كبيرة، أو اتصالات بينية سريعة، أو محركات تنفيذ مرنة؛ إنهم يغيرون فقط من يملك النموذج.

وهذا أمر مهم لأن العديد من النماذج المفتوحة تتطور بسرعة، وبما أنها تتضمن نوافذ سياقية أكبر، والمزيد من الخبراء، ومدخلات متعددة الوسائط، فإن آثار ذاكرتها سوف تنمو. وينطبق هنا أيضًا تركيز هوانج على المرونة؛ دعم النماذج المفتوحة على نطاق واسع لا يقلل من أهمية HBM أو وحدات معالجة الرسومات للأغراض العامة. وفي كثير من الحالات يزيده.

المعنى الضمني هو أن الذكاء الاصطناعي مفتوح المصدر واستراتيجيات الذاكرة البديلة لا تشكل تهديدات وجودية لمنصة نفيديا. وهي متغيرات إضافية تزيد من تنوع عبء العمل. ومن وجهة نظر نفيديا، فإن هذا التنوع يعزز حالة الأجهزة التي يمكنها التكيف بدلاً من التخصص.

لماذا تستمر Nvidia في اختيار HBM؟

وفي نهاية المطاف، فإن تعليقات هوانج في معرض CES ترقى إلى مستوى بيان واضح للأولويات. Nvidia على استعداد لقبول تكاليف أعلى لفاتورة المواد، والاعتماد على HBM النادرة، وتصميمات الأنظمة المعقدة لأنها تحافظ على الاختيارية. يحمي هذا الخيار العملاء من الانغلاق في نطاق أداء ضيق ويحمي Nvidia من التحولات المفاجئة في بنية النموذج التي يمكن أن تقلل من قيمة مجموعة المسرعات الأكثر صرامة.

يساعد هذا الموقف أيضًا في تفسير سبب كون Nvidia أقل عدوانية من بعض المنافسين في دفع شرائح الاستدلال ذات الغرض الواحد أو التصميمات الثقيلة ذات سعة SRAM. يمكن لهذه الأساليب أن تفوز بالمعايير وتجذب الانتباه، لكنها تفترض مستوى من القدرة على التنبؤ بعبء العمل لم يعد النظام البيئي الحالي للذكاء الاصطناعي يوفره.

حجة هوانغ ليست أن الأجهزة المتخصصة ليس لها مكان. بل في مراكز البيانات المشتركة، تظل المرونة هي العامل الاقتصادي المهيمن. وطالما استمرت أبحاث الذكاء الاصطناعي في استكشاف بنيات جديدة وخطوط أنابيب هجينة، فمن غير المرجح أن يتغير هذا المنطق.

في الوقت الحالي، يبدو هوانج واثقًا من أن العملاء سيستمرون في الدفع مقابل هذه المرونة، حتى عندما يشكون من تكلفة HBM وسعر وحدات معالجة الرسومات. وتشير تصريحاته إلى أن الشركة لا ترى أي تناقض في هذا الأمر. قد يتم تحدي هذا الرأي إذا استقرت نماذج الذكاء الاصطناعي أو تجزأت إلى مستويات يمكن التنبؤ بها، ولكن في الوقت الحالي، أوضح هوانج أن إنفيديا لا تعتقد أن تلك اللحظة قد حانت بعد.

التعليقات