كشفت Nvidia النقاب عن وحدة معالجة اللغة Groq 3 في GTC 2026 في سان خوسيه يوم الاثنين، مما يمثل أول شريحة تخرج من صفقة الترخيص والمواهب بقيمة 20 مليار دولار مع شركة Groq الناشئة للاستدلال بالذكاء الاصطناعي، والتي تم إبرامها عشية عيد الميلاد العام الماضي. يتم إدخال مسرع الاستدلال المستند إلى SRAM في منصة Vera Rubin كمعالج مشترك مخصص لمرحلة فك التشفير، وتخطط Nvidia لشحنه في الربع الثالث من عام 2026، والذي تم تصنيعه بواسطة Samsung باستخدام عملية 4 نانومتر. إنه أول منتج على نطاق واسع للشركة يتم تصنيعه حول السيليكون الذي لا يحتوي على وحدة معالجة الرسومات – وقد أدى وصوله بالفعل إلى إزاحة شريحة Nvidia محلية الصنع من خارطة الطريق.

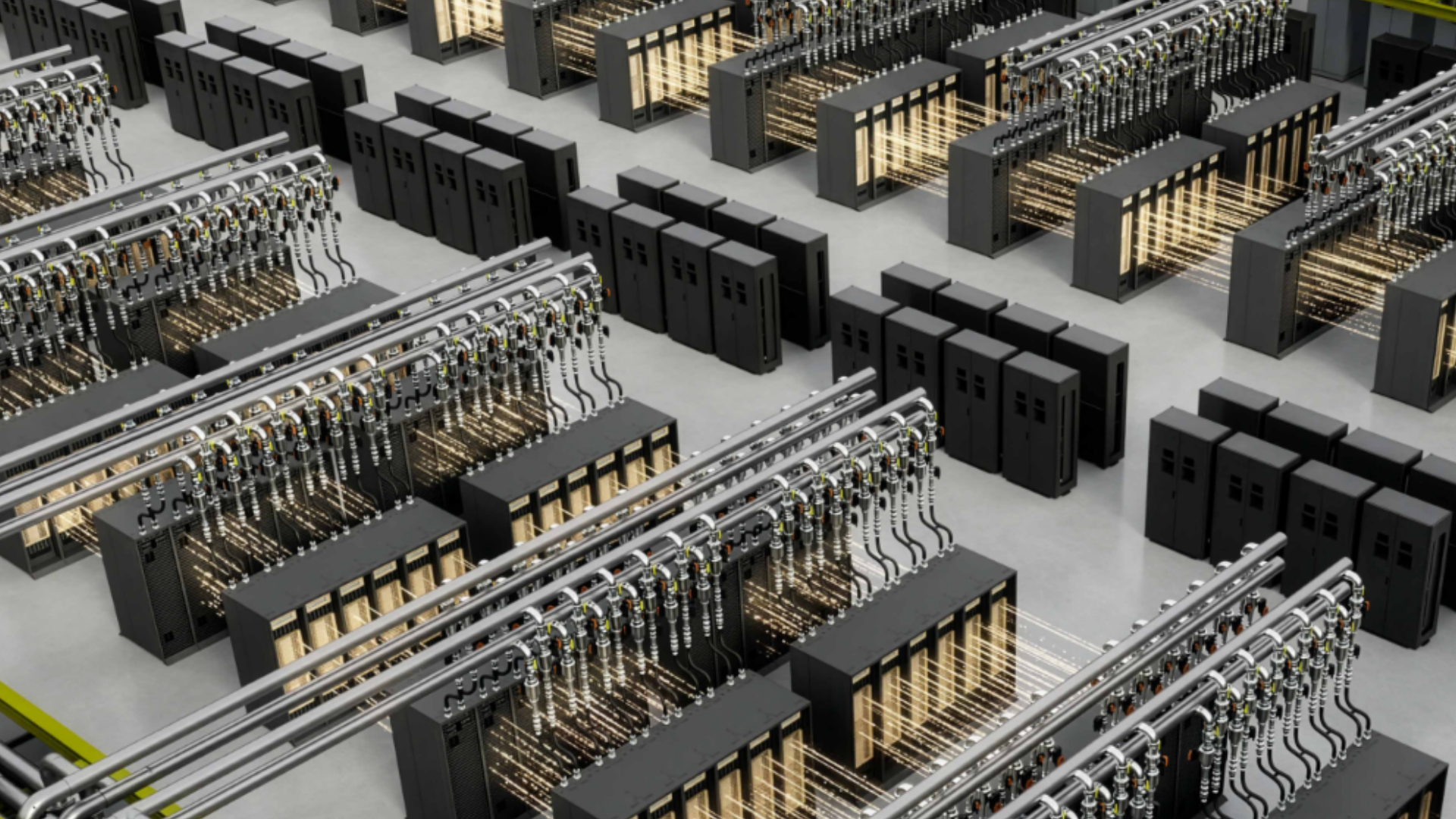

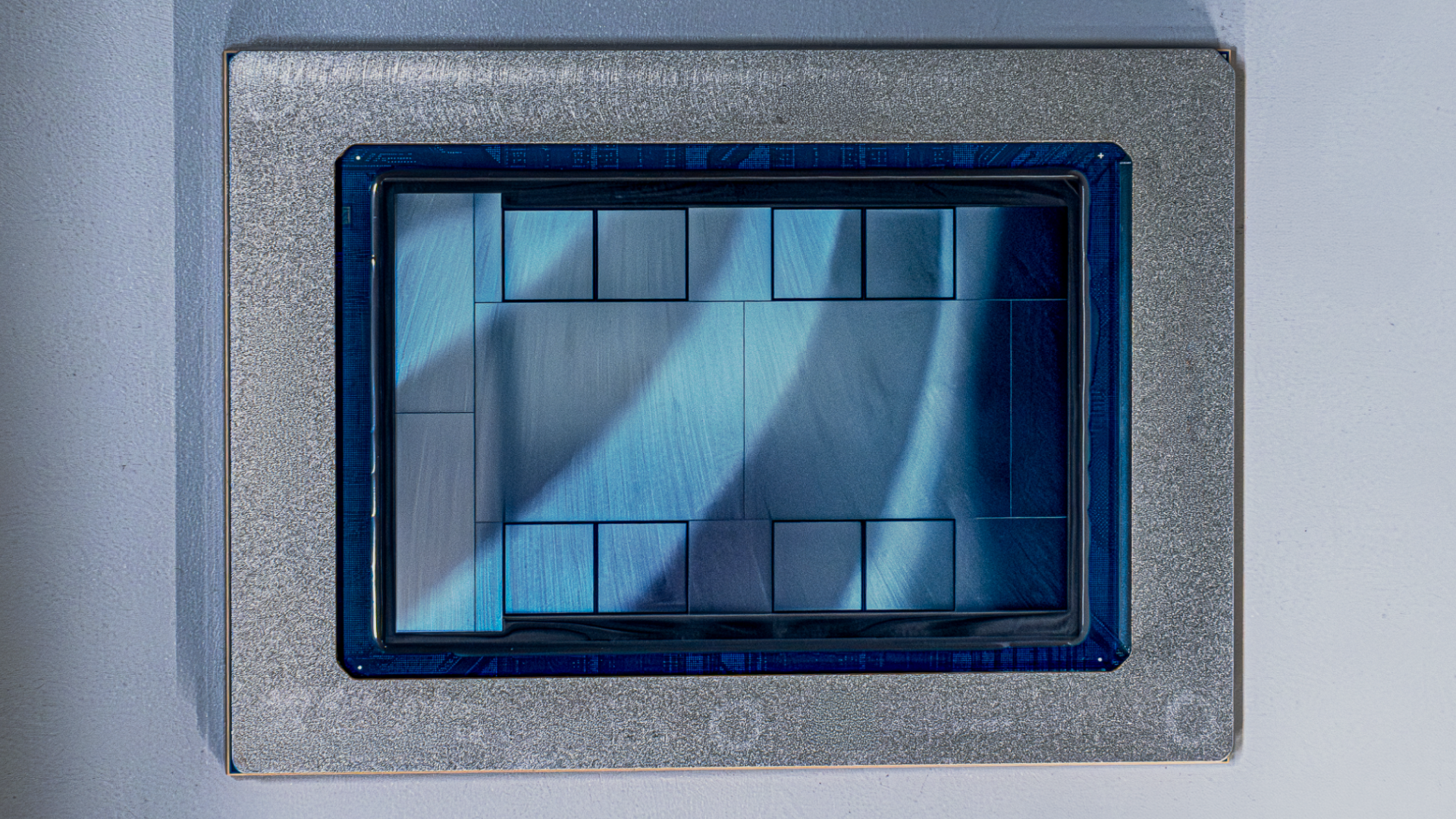

تحمل شريحة LP30 الموجودة في قلب حامل Groq 3 LPX 512 ميجابايت من ذاكرة SRAM على الشريحة لكل قالب، مما يوفر 150 تيرابايت/ثانية من عرض النطاق الترددي للذاكرة. هذا الرقم يقزم 22 تيرابايت / ثانية المتوفرة من 288 جيجابايت من HBM4 على كل وحدة معالجة رسومات Rubin. يحتوي حامل LPX الكامل على 256 وحدة LPU بإجمالي 128 جيجابايت من ذاكرة SRAM و40 بيتابت/ثانية من إجمالي عرض النطاق الترددي. تدعي Nvidia أن حامل LPX، المقترن بـ Vera Rubin NVL72، يوفر إنتاجية أعلى بمقدار 35 مرة لكل ميجاوات من Blackwell NVL72 وحده لنماذج تريليون معلمة، عند نقطة سعر مستهدفة تبلغ 45 دولارًا لكل مليون رمز.

جروك 3 وفيرا روبين

تتعامل وحدات معالجة الرسوميات Rubin مع مرحلة التعبئة المسبقة كثيفة الحوسبة للاستعلام، ومعالجة سياقات الإدخال الطويلة، بينما تتولى وحدات معالجة الرسومات Groq مرحلة فك التشفير، مما يؤدي إلى إنشاء رموز الإخراج في زمن استجابة منخفض. تدير منصة التوزيع Dynamo من Nvidia الانقسام عبر الأجهزة غير المتجانسة، وتوزع أحمال العمل بناءً على حجم الدفعة ومتطلبات التوازي.

يستمر المقال أدناه

استخدم التصميم الأصلي لما قبل Nvidia Groq LPU خط أنابيب ثابت لكلمات التعليمات الطويلة جدًا (VLIW) ومجموعات SRAM كبيرة على الرقاقة، مع قيام المترجم بجدولة مسار التنفيذ بالكامل مسبقًا في وقت الترجمة، مما يعني زمن انتقال محدد مع عدم وجود أخطاء في ذاكرة التخزين المؤقت أو الأكشاك. أظهرت هذه الرقائق أيضًا معدلات رمزية خام لمستخدم واحد بالآلاف في الثانية، ولكن ضعف البنية كان دائمًا هو القدرة. عند 230 ميجابايت من ذاكرة الوصول العشوائي (SRAM) لكل شريحة في الأجيال السابقة، كان تركيب النماذج متوسطة الحجم يتطلب عددًا كبيرًا من الرقائق، وتم تصميم البنية في البداية للشبكات العصبية التلافيفية.

يعالج Groq LP30 بعض هذه القيود من خلال 512 ميجابايت من ذاكرة SRAM لكل قالب و1.23 FP8 PFLOPS من القدرة الحسابية. قامت شركة Samsung بزيادة الإنتاج من ما يقرب من 9000 رقاقة إلى حوالي 15000 رقاقة مع تحول الإنتاج من العينات إلى التصنيع التجاري، مع إعلان AWS في GTC أنها ستنشر وحدات Groq 3 LPU جنبًا إلى جنب مع أكثر من مليون وحدة معالجة رسوميات Nvidia كجزء من شراكة موسعة.

بعد LP30، سيضيف LP35 المستقبلي دعم NVFP4، بما يتماشى مع جيل Rubin Ultra، ومن المقرر أن يكون LP40 لدورة Feynman المعمارية بعد ذلك.

تم استبعاد روبن CPX؟

كان أحد الغيابات الواضحة عن GTC هو Rubin CPX، وهو مسرع استدلال قائم على GDDR7 تم الإعلان عنه في سبتمبر 2025 كجزء من منصة Vera Rubin؛ لقد كانت غائبة عن جميع الشرائح الرئيسية ولم تحصل على أي وقت على المسرح. يبدو – على الرغم من عدم تأكيده رسميًا – أنه تمت إزالة CPX من خريطة طريق Nvidia بالكامل، وتم استبداله في التسلسل الهرمي للنظام الأساسي بـ Groq 3 LPX.

تم تصميم Rubin CPX لاستخدام ذاكرة GDDR7 الأرخص والأكثر توفرًا لتسريع مرحلة سياق الاستدلال عند الطاقة الأقل. لكن Groq LPU توفر عرض نطاق ترددي أعلى دون الحاجة إلى كميات كبيرة من أي ذاكرة خارجية، وهو مثالي في السوق حيث لا يزال عرض HBM محدودًا، ولا يزال إنتاج GDDR7 يتوسع. لا يزال من الممكن شحن أجزاء خرائط الطرق الوعرة إلى العملاء الذين استثمروا بالفعل في تحسين برامج CPX، ولكن هناك تحول واضح في الأولويات في Nvidia.

هناك أيضًا مقارنة غريبة بين هذا والاستحواذ على Mellanox في عام 2019. وانتهى ذلك بتحويل تقنيات NVLink وInfiniBand من Nvidia إلى بنية تحتية أساسية لمجموعات الذكاء الاصطناعي. ويبدو أن شركة Groq تتبع مسارًا مشابهًا، حيث يتم استيعاب التكنولوجيا الناشئة في المنصة كطبقة معمارية جديدة دائمة.

توحيد شريحة الاستدلال

تعد صفقة Groq من Nvidia هي الأكبر في موجة من عمليات الاستحواذ التي تركز على الاستدلال والتي اجتاحت صناعة أشباه الموصلات في عام 2025. في يونيو، استحوذت AMD على الفريق الهندسي من Untether AI، مطور شرائح الاستدلال RISC-V، بعد إغلاق الشركة الناشئة، ودفعت Nvidia نفسها أكثر من 900 مليون دولار لفريق Enfabrica لبدء تشغيل الشبكات وIP في سبتمبر. استحوذت شركة Meta على شركة Rivos الناشئة للرقائق المخصصة في أكتوبر، وحاولت شركة Intel شراء SambaNova مقابل 1.6 مليار دولار، لكن المحادثات انهارت؛ واستقرت الشركتان على استثمار بقيمة 350 مليون دولار وشراكة متعددة السنوات الشهر الماضي بدلاً من ذلك.

هناك نمط ثابت هنا، حيث يتم استيعاب الشركات الناشئة الكبيرة في مجال شرائح الاستدلال المستقلة، وقد أثبتت اقتصاديات التنافس بشكل مستقل ضد النظام البيئي CUDA الخاص بـ Nvidia أنها غير مستدامة بغض النظر عن الجدارة التقنية. كانت شركة Groq نفسها تستهدف تحقيق إيرادات بقيمة 500 مليون دولار للسنة المالية 2025، لكن حتى هذا لم يكن كافيًا للحفاظ على الاستقلال. أشارت ستايسي راسجون، المحللة في برنشتاين، في تقرير بحثي إلى أن هيكل الترخيص غير الحصري للصفقة قد يبقي “خيال المنافسة حيًا” بينما يحيد المنافس بشكل فعال.

Hyperscaler السيليكون المخصص

بينما تندمج الشركات الناشئة في الشركات القائمة، يقوم أصحاب النطاقات الفائقة ببناء أجهزة الاستدلال الخاصة بهم بوتيرة متسارعة.

أعلنت Meta عن أربعة أجيال متتالية من شرائح MTIA في 11 مارس، تم تطويرها جميعًا بالشراكة مع Broadcom: MTIA 300 (قيد الإنتاج بالفعل للتدريب على التصنيف والتوصية)، وMTIA 400 (استكمال الاختبارات المعملية)، وMTIA 450، وMTIA 500، حيث يستهدف الأخيران استدلال الذكاء الاصطناعي التوليدي ومن المقرر نشرهما على نطاق واسع في عام 2027. وقد نشرت الشركة بالفعل مئات الآلاف من شرائح MTIA السابقة للاستدلال عبر تطبيقاتها. من MTIA 300 إلى 500، يزيد عرض النطاق الترددي لـ HBM 4.5 مرات، ويزداد حساب FLOPS 25 مرة.

يوفر إصدار Ironwood TPU v7 من Google 4,614 TFLOPS لكل شريحة مع 192 جيجابايت من HBM لكل قالب، ويمتد إلى 42.5 exaflops في 9,216 شريحة. تواصل AWS تطوير Trainium وInferentia، على الرغم من أن البيانات الداخلية التي تم الإبلاغ عنها في عام 2024 أظهرت أن Trainium عند 0.5% فقط من استخدام Nvidia GPU داخل AWS وInferentia عند 2.7%، مما يشير إلى تأخر الاعتماد.

تظهر أرقام الإنفاق أيضًا هذا التنوع، حيث وجد استطلاع أجرته مجموعة Futurum Group في نوفمبر 2025 أنه من المتوقع أن تقود مسرعات XPU نمو الإنفاق على حوسبة مراكز البيانات بنسبة 22% في عام 2026، متجاوزة وحدات معالجة الرسومات بنسبة 19% ووحدات المعالجة المركزية بنسبة 14%. وفي الوقت نفسه، تتوقع TrendForce نمو شحنات ASIC المخصصة من موفري الخدمات السحابية بنسبة 44.6% في عام 2026، مقارنة بنمو قدره 16.1% لشحنات وحدات معالجة الرسومات.

رد Nvidia هو التأكد من أن نظامها الأساسي يحتوي على سيليكون غير مزود بوحدة معالجة الرسومات قبل أن يفعله أي شخص آخر، وGroq 3 LPU هو نتاج ذلك. وفي الوقت نفسه، يبدو مستقبل Rubin CPX غير مؤكد، على الأقل في الوقت الحالي.

التعليقات