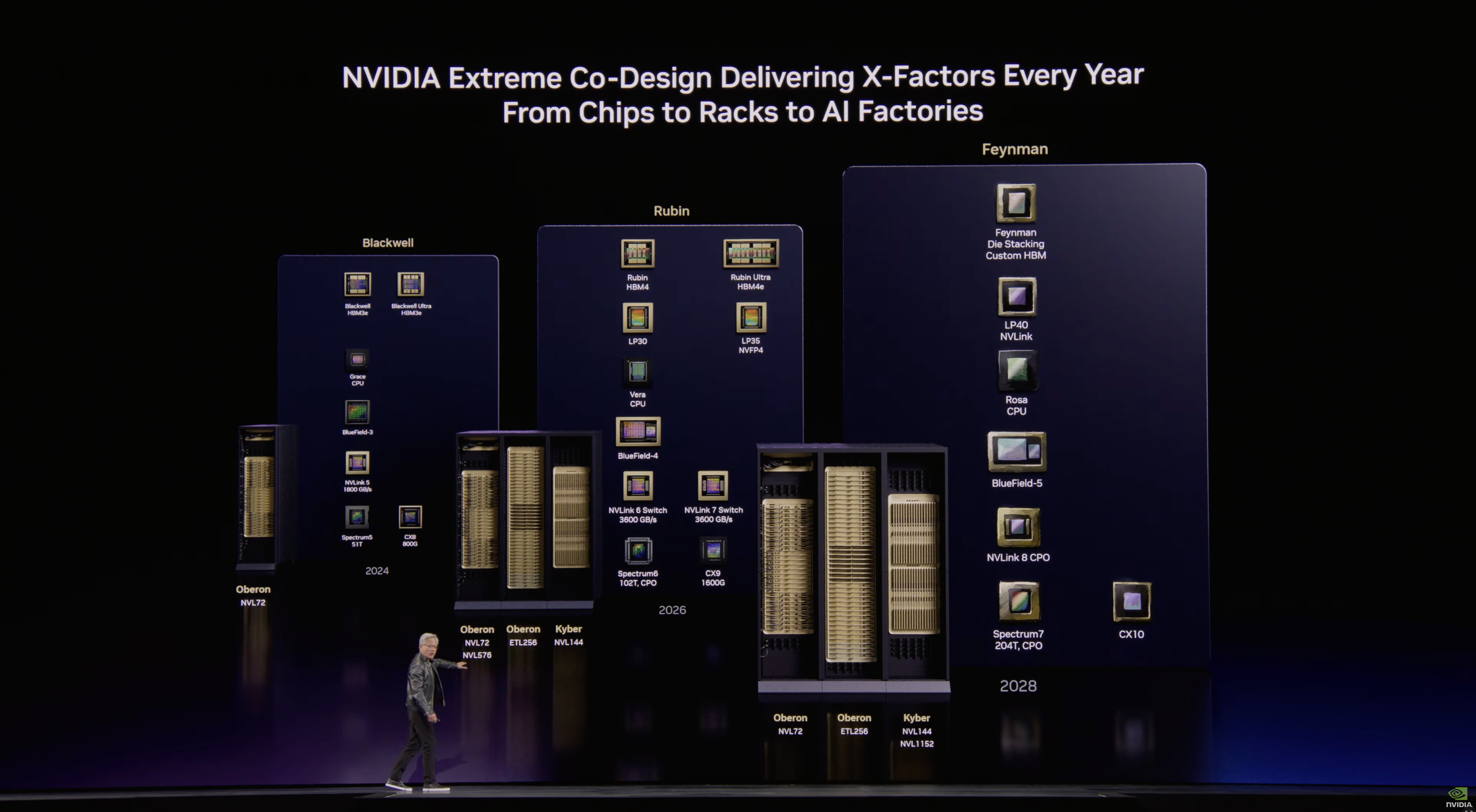

قدمت Nvidia خارطة طريق منتج مركز البيانات المحدثة في مؤتمر تكنولوجيا GPU الخاص بها هذا الأسبوع، وكشفت عن العديد من المفاجآت ولكنها مطمئنة في الغالب إلى أن الشركة تسير على الطريق الصحيح لتقديم بنية GPU جديدة تمامًا كل عامين وتحديث عائلة GPU AI كل عام. كما اتضح، تعتزم Nvidia استخدام نظام تكديس القوالب وذاكرة HBM المخصصة مع وحدات معالجة الرسوميات Feynman الخاصة بها، والتي ستكون مصحوبة أيضًا بوحدات المعالجة المركزية Rosa، والتي لم يتم ذكرها مسبقًا في خريطة الطريق.

2026: روبن، فيرا، LP30، بلوفيلد-4

يستمر المقال أدناه

2027: روبين ألترا، LP35، NVLink 7

وفي العام المقبل، تخطط الشركة لتحديث عروضها باستخدام مسرعات Rubin Ultra AI، والتي ستحتوي على أربع شرائح حاسوبية صغيرة وستكون مجهزة بذاكرة HBM4E بسعة 1 تيرابايت، وبالتالي زيادة الأداء بشكل كبير مقارنة بـ Rubin هذا العام. بالإضافة إلى ذلك، سيتم دمج مسرعات وحدة معالجة الرسومات هذه مع Groq LP35 LPU، والتي ستدعم تنسيق البيانات NVFP4 وبالتالي تحسين الأداء.

هناك تحسن ملموس آخر في الأداء لمنصات الذكاء الاصطناعي من Nvidia وهو تقديم حل Kyber NVL144 على نطاق الرفوف الخاص بالشركة، والذي سيحزم 144 حزمة Rubin Ultra GPU (ممكنة بواسطة مفتاح NVLink 7) وبالتالي يقدم تحسينًا في الأداء 4X على الأقل مقارنة بأرفف Oberon NVL72 مع 72 حزمة Blackwell GPU.

2028: فاينمان، روزا، LP40، NVLink يتحول إلى البصريات

ستتحسن محفظة مراكز بيانات Nvidia في عام 2027 من خلال زيادة عدد وحدات معالجة الرسومات لكل حامل (أي التحسينات الكمية) وإدخال LPU جديد بدعم NVFP4. ستعتمد منتجات مركز بيانات الشركة لعام 2028 على بنيات جديدة تمامًا ستجلب تحسينات نوعية لمنتجات الشركة.

وقال جنسن هوانغ، الرئيس التنفيذي لشركة نفيديا، في GTC: “الجيل القادم من هنا هو فاينمان”. “يمتلك Feynman وحدة معالجة رسوميات جديدة بالطبع، ولديه أيضًا LPU LP40 جديد […] الآن توحيد نطاق Nvidia وGroq معًا LP40، سيكون أمرًا لا يصدق. وحدة معالجة مركزية جديدة تمامًا تسمى Ros، وهي اختصار لـ Rosalyn، Bluefield-5، والتي تربط وحدة المعالجة المركزية التالية بـ SuperNIC CX10 التالي. سيكون لدينا Kyber، وهو مقياس نحاسي، وسيكون لدينا Kyber مقياس CPO. لذا، ولأول مرة، سوف نقوم بتوسيع نطاق استخدام كل من البصريات النحاسية والبصريات المجمعة معًا.”

أولاً، ستعتمد وحدة معالجة الرسومات الخاصة بمركز بيانات Feynman من Nvidia تقنية تكديس القوالب، مما سيتيح للشركة طريقة جديدة لتوسيع نطاق الأداء. ثانيًا، ستستخدم وحدات معالجة رسوميات Feynman أيضًا ذاكرة مخصصة ذات نطاق ترددي عالٍ (على الأرجح نسخة مختلفة من C-HBM4E)، والتي من المحتمل أن تمكن Nvidia من تعزيز سعة HBM بما يتجاوز 1 تيرابايت لكل حزمة GPU وزيادة عرض النطاق الترددي للذاكرة.

ثالثًا، سيتم تشغيل منصات Feynman بواسطة وحدات المعالجة المركزية Rosa، وهي معالجات الجيل التالي من Nvidia التي تم تطويرها داخليًا مع التركيز على الأداء النهائي للخيط الواحد. يظهر ظهور روزا أن الشركة قامت بتقصير دورة تطوير وحدة المعالجة المركزية الخاصة بها من أربع سنوات إلى سنتين (ربما من خلال تقديم فريق تصميم جديد)، مما يجعلها على قدم المساواة مع مطوري وحدة المعالجة المركزية الرائدين AMD وIntel، اللتين تميلان إلى إطلاق معماريات دقيقة جديدة كل عامين.

رابعًا، ستقوم هذه المنصة أيضًا بدمج LP40 LPU، والذي لن يدعم تنسيق NVFP4 الخاص بـ Nvidia فحسب، بل سيتصل أيضًا بمكونات النظام الأخرى باستخدام بروتوكول NVLink، وبالتالي دمج أجهزة Groq مع وحدات معالجة الرسومات الخاصة بـ Nvidia.

خامسًا، ستكون منصة Feynman أيضًا أول من يتبنى محولات NVLink ذات البصريات المجمعة، والتي ستمكن التوصيلات الضوئية باستخدام بروتوكول NVLink (وهي ليست مستحيلة اليوم، لكن CPO يجعلها أسهل بكثير وأقل تكلفة في التنفيذ). ستمكن الروابط البصرية Nvidia من زيادة الحجم العالمي لحلولها على نطاق الحامل إلى 576 حزمة GPU (باستخدام هيكل Oberon) أو حتى 1152 حزمة GPU (باستخدام هيكل Kyber)، مما سيجعل أنظمة الشركة على نطاق الحامل أكثر قدرة على المنافسة ضد الحلول البديلة مثل AMD's Instinct أو المسرعات المخصصة التي يتم نشرها بواسطة المقياس الفائق مما هي عليه اليوم.

وأخيرًا وليس آخرًا، تخطط Nvidia لتقديم BlueField 5 DPU,7ذ إنشاء SpectrumX Ethernet مع بصريات مدمجة، بالإضافة إلى ConnectX 10 SuperNIC في عام 2028.

يتبع أجهزة توم على أخبار جوجل، أو أضفنا كمصدر مفضل، للحصول على آخر الأخبار والتحليلات والمراجعات في خلاصاتك.

التعليقات