- وجدت GTIG أن الجهات الفاعلة في مجال التهديد تستنسخ نماذج الذكاء الاصطناعي الناضجة باستخدام هجمات التقطير

- يمكن للبرامج الضارة المتطورة استخدام الذكاء الاصطناعي لمعالجة التعليمات البرمجية في الوقت الفعلي لتجنب اكتشافها

- وتقوم المجموعات التي ترعاها الدولة بإنشاء مجموعات تصيد وحملات هندسة اجتماعية مقنعة للغاية

إذا كنت قد استخدمت أي أدوات حديثة للذكاء الاصطناعي، فستعرف أنها يمكن أن تكون مساعدة كبيرة في تقليل ملل المهام الدنيوية والمرهقة.

حسنًا، اتضح أن الجهات الفاعلة في مجال التهديد تشعر بنفس الطريقة، حيث وجد تقرير Google Threat Intelligence Group AI Threat Tracker أن المهاجمين يستخدمون الذكاء الاصطناعي أكثر من أي وقت مضى.

بدءًا من اكتشاف كيفية تفكير نماذج الذكاء الاصطناعي من أجل استنساخها، ووصولاً إلى دمجها في سلاسل الهجوم لتجاوز الكشف التقليدي القائم على الشبكة، حددت GTIG بعضًا من التهديدات الأكثر إلحاحًا – وإليك ما وجدوه.

كيف تستخدم الجهات الفاعلة في مجال التهديد الذكاء الاصطناعي في الهجمات

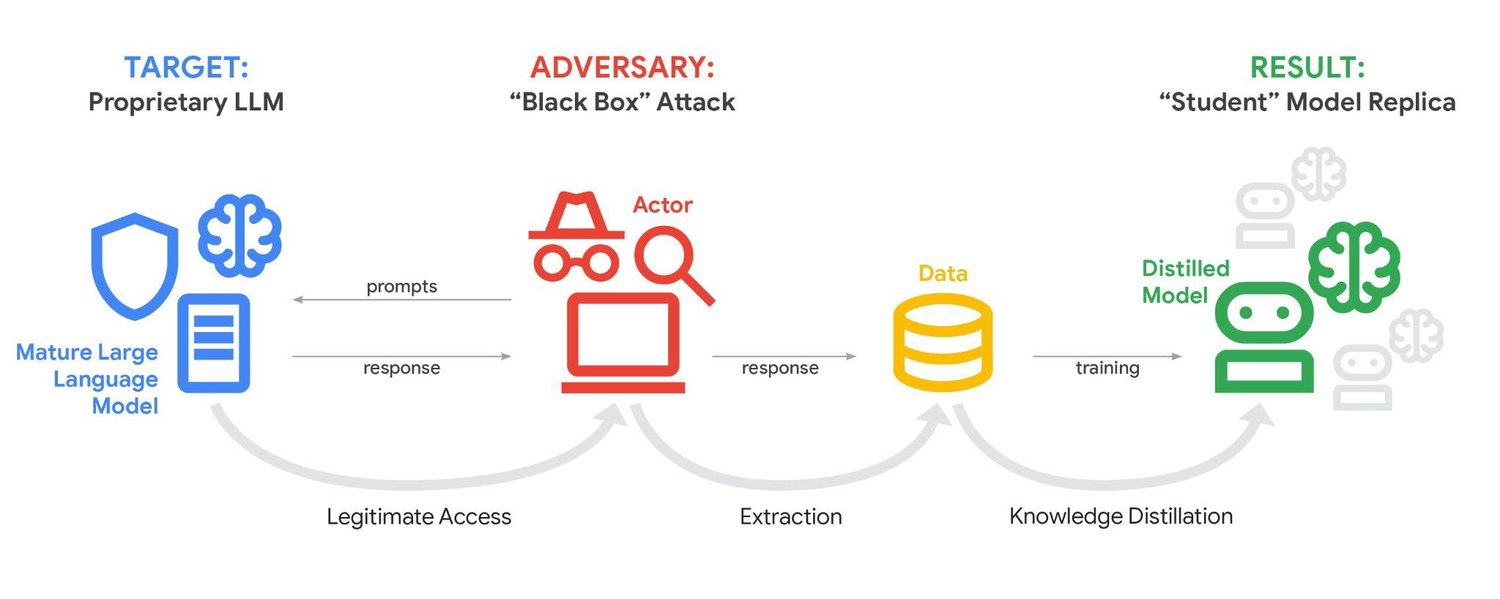

بالنسبة للمبتدئين، وجدت مجموعة GTIG أن الجهات الفاعلة في مجال التهديد تستخدم بشكل متزايد “هجمات التقطير” لاستنساخ نماذج لغوية كبيرة بسرعة بحيث يمكن استخدامها من قبل الجهات الفاعلة في مجال التهديد لأغراضها الخاصة. سيستخدم المهاجمون عددًا كبيرًا من المطالبات لمعرفة كيفية تفسير LLM للاستعلامات، ثم استخدام الردود لتدريب نموذجهم الخاص.

يمكن للمهاجمين بعد ذلك استخدام نموذجهم الخاص لتجنب الدفع مقابل الخدمة المشروعة، أو استخدام النموذج المقطر لتحليل كيفية إنشاء LLM، أو البحث عن طرق لاستغلال نموذجهم الخاص والذي يمكن استخدامه أيضًا لاستغلال الخدمة المشروعة.

يتم استخدام الذكاء الاصطناعي أيضًا لدعم جمع المعلومات الاستخبارية وحملات الهندسة الاجتماعية. استخدمت كل من الجماعات التي ترعاها الدولة الإيرانية والكورية الشمالية أدوات الذكاء الاصطناعي بهذه الطريقة، حيث تستخدم الأولى الذكاء الاصطناعي لجمع معلومات حول العلاقات التجارية من أجل خلق ذريعة للاتصال، وتستخدم الأخيرة الذكاء الاصطناعي لدمج المعلومات الاستخبارية للمساعدة في التخطيط للهجمات.

وقد رصدت GTIG أيضًا ارتفاعًا في استخدام الذكاء الاصطناعي لإنشاء مجموعات تصيد مقنعة للغاية للتوزيع على نطاق واسع من أجل الحصول على بيانات الاعتماد.

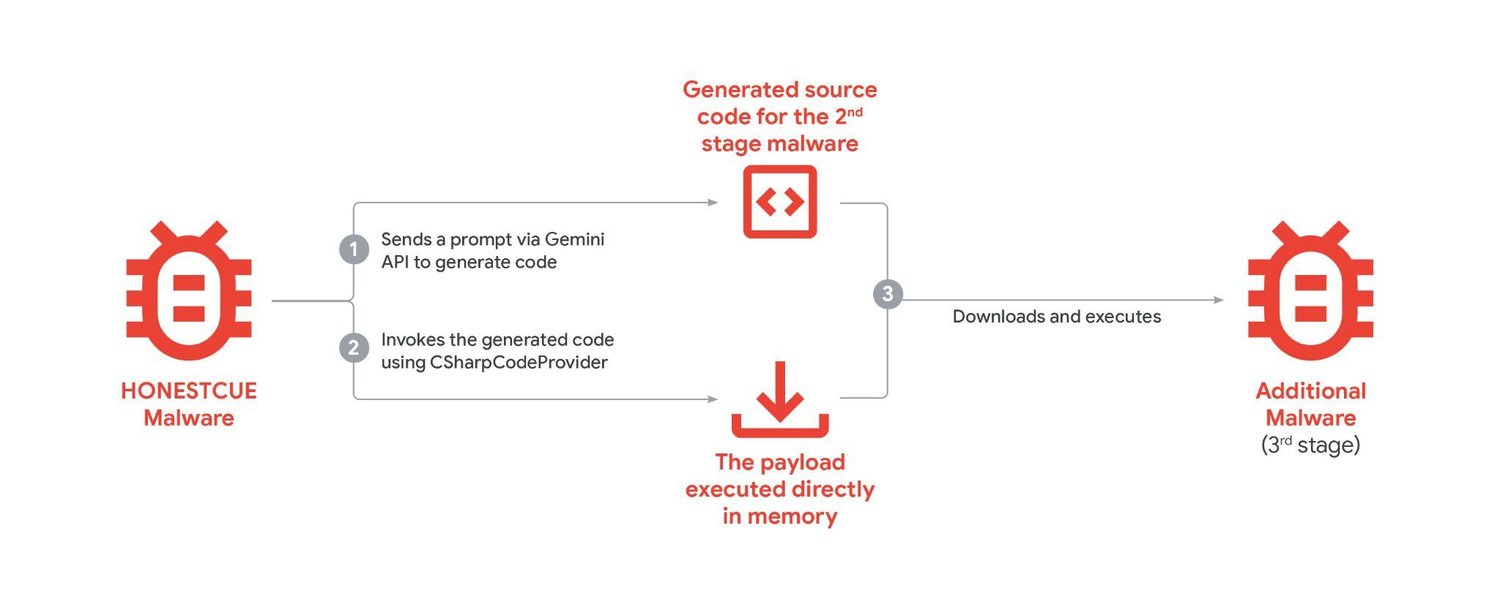

علاوة على ذلك، تقوم بعض الجهات الفاعلة في مجال التهديد بدمج نماذج الذكاء الاصطناعي في البرامج الضارة للسماح لها بالتكيف لتجنب اكتشافها. أحد الأمثلة، الذي تم تتبعه باسم HONESTCUE، نجح في تفادي الكشف المستند إلى الشبكة والتحليل الثابت باستخدام Gemini لإعادة كتابة التعليمات البرمجية وتنفيذها أثناء الهجوم.

ولكن ليست كل الجهات التهديدية متشابهة. لاحظت GTIG أيضًا أن هناك طلبًا كبيرًا على أدوات الذكاء الاصطناعي المخصصة المصممة للمهاجمين، مع دعوات محددة للأدوات القادرة على كتابة التعليمات البرمجية للبرامج الضارة. في الوقت الحالي، يعتمد المهاجمون على استخدام هجمات التقطير لإنشاء نماذج مخصصة لاستخدامها بشكل هجومي.

ولكن إذا أصبحت هذه الأدوات متاحة على نطاق واسع وسهلة التوزيع، فمن المحتمل أن تتبنى جهات التهديد الذكاء الاصطناعي الخبيث بسرعة في ناقلات الهجوم لتحسين أداء البرامج الضارة والتصيد وحملات الهندسة الاجتماعية.

من أجل الدفاع ضد البرامج الضارة المعززة بالذكاء الاصطناعي، تقوم العديد من الحلول الأمنية بنشر أدوات الذكاء الاصطناعي الخاصة بها للرد. بدلاً من الاعتماد على التحليل الثابت، يمكن استخدام الذكاء الاصطناعي لتحليل التهديدات المحتملة في الوقت الفعلي للتعرف على سلوك البرامج الضارة المعززة بالذكاء الاصطناعي.

يتم أيضًا استخدام الذكاء الاصطناعي لفحص رسائل البريد الإلكتروني والرسائل من أجل اكتشاف التصيد الاحتيالي في الوقت الفعلي على نطاق يتطلب آلاف الساعات من العمل البشري.

علاوة على ذلك، تبحث Google بنشاط عن استخدامات الذكاء الاصطناعي التي قد تكون ضارة في Gemini، وقد نشرت أداة للمساعدة في البحث عن ثغرات البرامج (Big Sleep)، وأداة للمساعدة في تصحيح الثغرات الأمنية (CodeMender).

أفضل برامج مكافحة الفيروسات لجميع الميزانيات

التعليقات